پژوهشی جدید نشان میدهد که پس از فراگیرشدن چتباتهای هوش مصنوعی، الگوهای زبانی انسانها، بهویژه در میان دانشگاهیان و سخنرانان، بهطرز قابلتوجهی تغییر کرده است. این افراد واژههایی بهکار میبرند که از هوش مصنوعی شنیدهاند؛ محققان میگویند ممکن است ظرافتها و تنوع زبانی خود را از دست بدهیم و به سمت گفتاری یکنواخت و ماشینی حرکت کنیم.

آیا در مدت اخیر متوجه شدهاید که برخی افراد، بهویژه در سخنرانیهای رسمی یا گفتگوهای تخصصی، به شکلی عجیب شبیه به چتباتها صحبت میکنند؟ برای مثال ممکن است دوستتان به شما بگوید دارد روی موضوعی «کندوکاو» (Delve) میکند و در برخی فعالیتها «زبردستتر» (Adept) شده است. به گزارش TechRadar، محققان در مؤسسه ماکس پلانک آلمان معتقدند چتباتهای هوش مصنوعی روی گفتار انسان تأثیر گذاشته است.

تأثیر چتباتهای هوش مصنوعی بر گفتار انسان

در یک مطالعه گسترده، محققان با تجزیهوتحلیل ۲۸۰ هزار ویدیوی دانشگاهی از بیش از ۲۰ هزار کانال یوتوب، دریافتند که پس از عرضه ChatGPT، استفاده از برخی کلمات خاص به شدت افزایش یافته است. کلماتی مانند:

- Delve (کندوکاو کردن)

- Realm (قلمرو، حوزه)

- Adept (زبردست، متبحر)

- Meticulous (موشکافانه، دقیق)

این کلمات که در نوشتههای هوش مصنوعی بسیار رایج هستند، اکنون در گفتار انسانها نیز با فراوانی تا ۵۰ درصد بیشتر از قبل مشاهده میشوند. نکته مهم این است که این افراد لزوماً از متنهای هوش مصنوعی استفاده نمیکنند، بلکه ناخودآگاه، واژگان و الگوهای زبانی آن را جذب و تقلید میکنند.

شاید در نگاه اول استفاده از چند کلمه جدید چندان مهم به نظر نرسد، اما محققان نگران پیامدهای عمیقتر آن هستند. این مطالعه نشان میدهد که این کلمات ماشینی، درحال جایگزین شدن با زبان زندهتر، پیچیدهتر و با ساختار کمتر هستند. این فرایند که میتوان آن را نوعی «مترادفیاب هوش مصنوعی» نامید، بافت و غنای زبان را از بین میبرد. در بدترین حالت، این یکسانسازی میتواند به کاهش احساسات و ویژگیهای منحصربهفرد منطقهای منجر شود.

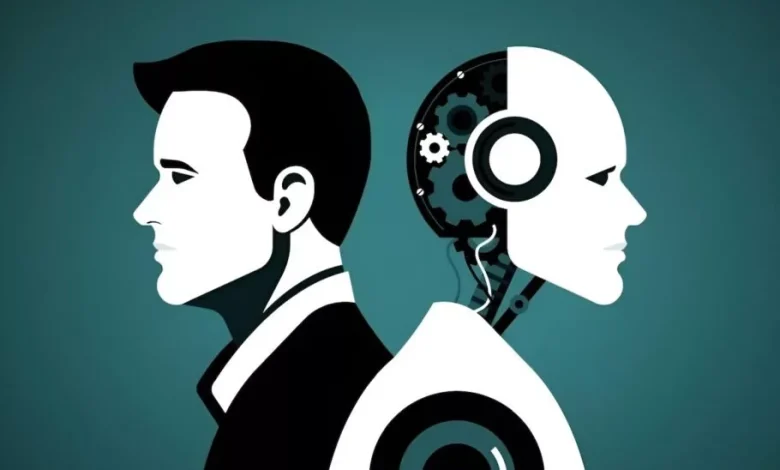

این پدیده تناقض جالبی دارد: ما هوش مصنوعی را ساختیم تا از گفتار انسان تقلید کند، اما اکنون این انسانها هستند که درحال تقلید از ماشینها هستند. البته این اولین بار نیست که فناوری زبان ما را شکل میدهد؛ تلگراف ما را به خلاصهگویی واداشت، تلفن «الو» را به یک استاندارد جهانی تبدیل کرد و شبکههای اجتماعی «هشتگ» را وارد مکالمات روزمره ما کردند.